⌨️ # 255 La programación y su futuro

Semana 255: ¿Hemos llegado a la AGI?

Hola, soy Alex Rayón Jerez. De #bilbao y #millennial (por los pelos). Disfruto mucho mis días en Brain & Code, donde aprendemos tecnología para liderar el futuro.

Bienvenido/a a mi newsletter Digital & Data. Somos más de 19.000 Sapiens (creo) reflexionando sobre cómo los humanos no entendemos una tecnología hasta que no la adoptamos masivamente. Que es, precisamente, lo que está ocurriendo con las tecnologías digitales.

Durante años nos convencimos de que automatizar era suficiente.

- Poner reglas. Encadenar “si pasa esto, haz aquello”.

- Y funcionó… mientras el mundo era predecible.

Pero hoy el negocio ya no sigue manuales.

- Cambia cada semana. Tiene excepciones. Vive en tiempo real.

- Y ahí la automatización clásica hace agua.Porque las reglas no piensan.

- No entienden contexto.

- No toman decisiones.

Los agentes de IA juegan en otra liga.

- No ejecutan procesos: persiguen objetivos.

- Interpretan señales, se adaptan sobre la marcha y deciden sin pedir permiso.

Por eso hemos creado el “Programa Experto en Automatización con IA en n8n“ - Si quieres diseñar flujos inteligentes, eliminar tareas repetitivas y mejorar la eficiencia operativa desde el primer día, aquí tienes una alternativa.

📷 Una imagen

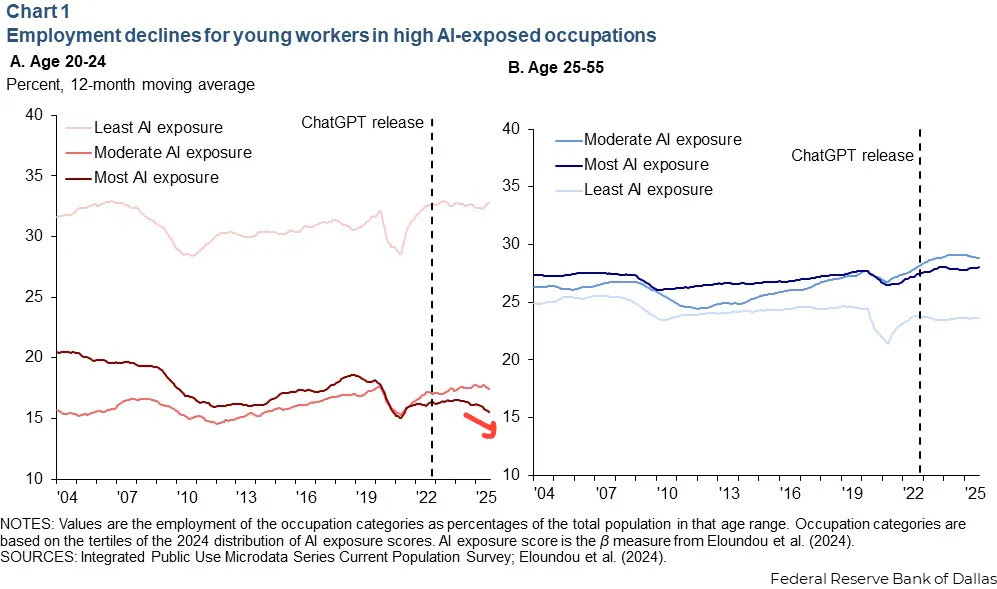

Estos días me han hecho un par de entrevistas en torno al empleo de los jóvenes en la era de la IA. Especialmente llamativa una conversación que tuve con una joven estudiante que estaba haciendo su TFG sobre el impacto de la IA en profesiones. La envié este estudio. En la era de la inteligencia artificial, los jóvenes se enfrentan a retos reales en su acceso al mercado laboral, especialmente en la entrada a su primer empleo. No es solo porque la IA esté sustituyendo puestos de trabajo (que hay bastante evidencia ya al respecto), sino porque el contexto general es de menor contratación y menos rotación (donde la IA también tiene su papel). Esto ocurre sobe todo en sectores donde la tecnología tiene mayor peso. Esto hace que los roles junior, tradicionalmente pensados para aprender y crecer, sean más escasos, elevando la exigencia de competencias desde el inicio y obligando a los jóvenes a diferenciarse antes, adaptarse más rápido y desarrollar habilidades que combinen criterio humano, capacidad de aprendizaje y uso inteligente de la IA como aliada, no como amenaza. Y, para mí, lo más importante: esto más que un mensaje hacia los jóvenes, creo que lo es hacia la gestión del talento en las organizaciones. Quizás lo que más debamos cambiar es cómo las organizaciones absorbemos talento, y no tanto que el talento se adapte. Necesitamos nuevas organizaciones y nuevos modelos de gestión.

📚 Cinco lecturas

#1 La programación y su futuro

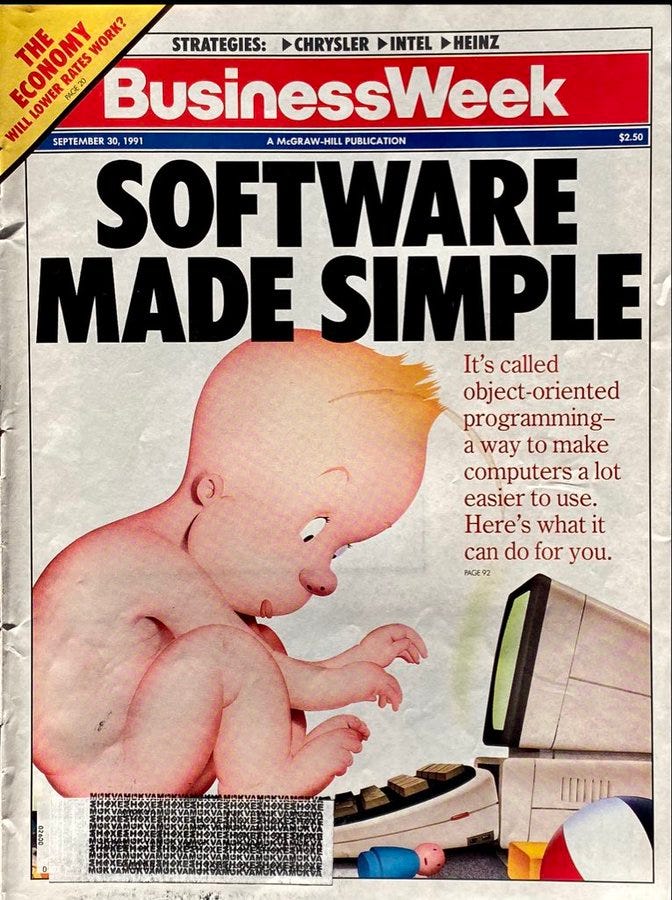

Todo lo que hoy nos inquieta alrededor de la IA agéntica y los asistentes de código ya lo hemos vivido antes en la historia de la informática. ¿Será nuestro fin? No lo creo. Sí una profunda readaptación. Pero, como muchas otras veces en la historia :-) Veamos.

Detalles

Cada gran salto tecnológico (del ensamblador a los lenguajes de alto nivel, de la programación estructurada a la orientada a objetos) vino acompañado del mismo miedo: perder el control. No era una discusión sobre calidad técnica, sino sobre confianza. Abstraer la complejidad siempre ha generado resistencia, porque obliga a soltar la ilusión de control absoluto y a confiar en sistemas que hacen más por nosotros de lo que podemos supervisar línea a línea.

La diferencia es que el patrón se repite, pero la lección sigue siendo la misma. FORTRAN, COBOL o la orientación a objetos no sustituyeron al programador ni eliminaron el pensamiento lógico; lo escalaron. Del mismo modo, los agentes y asistentes actuales no son una amenaza al criterio profesional, sino una invitación a reforzarlo.

¿Por qué es relevante?

El reto no es decidir si estas herramientas son perfectas (nunca lo fueron las anteriores), sino aprender a usarlas con controles, límites y responsabilidad. Como siempre en informática, la pregunta clave no ha sido si confiar ciegamente, sino cómo avanzar sin renunciar al entendimiento y al juicio humano.

#2 La Unión Europea y TikTok

Muy recomendable este post. La Unión Europea ha puesto el foco sobre TikTok y su diseño “adictivo”, al considerar que funcionalidades como el scroll infinito, la reproducción automática, las notificaciones y los algoritmos de recomendación pueden fomentar un uso compulsivo que afecta especialmente a menores y usuarios vulnerables. Un nuevo frente en el mundo de las antiguamente llamadas “redes sociales”.

Detalles

Según la Comisión Europea, estas características podrían violar la Ley de Servicios Digitales (DSA) porque no evalúan ni mitigan adecuadamente los riesgos para la salud física y mental, y en consecuencia el organismo reclama cambios profundos en la interfaz y mecanismos de la app para proteger a sus usuarios o enfrentarse a multas de hasta el 6 % de la facturación global de la plataforma.

Esta presión regulatoria se suma a un contexto judicial más amplio en el que TikTok y otras grandes plataformas han sido señaladas por diseños que maximizan la atención y el tiempo de uso, con acuerdos extrajudiciales alcanzados en algunos casos antes de juicios sobre adicción a redes sociales.

¿Por qué es relevante?

El cruce de acciones legales y regulatorias muestra una tendencia global hacia una mayor exigencia de responsabilidad y cambios estructurales en las redes sociales, con impacto potencial tanto en la experiencia de usuario como en los modelos de negocio de estas plataformas.

#3 El paper de Nature en torno a la AGI (supuesto Inteligencia Artificial General)

Estos días, en varios de los foros más “profundos” en los que estoy, hemos debatido mucho en torno a este paper que acaba de publicar Nature. La idea que publican y divulgan es clara: la AGI (Inteligencia Artificial General como la humana), está aquí. Me sorprende que una revista de este prestigio afirme así. Quién sabe los intereses que puede haber detrás.

Detalles

El principal problema no es tecnológico, sino conceptual: el propio concepto de AGI es difuso, mal definido y usado de forma contradictoria. Los autores del artículo original afirman que la AGI ya está aquí apoyándose en lo bien que los grandes modelos de lenguaje superan pruebas lingüísticas, alcanzan niveles expertos o incluso sobrehumanos en determinadas tareas.

Sin embargo, estas evidencias no demuestran inteligencia general, sino capacidades muy avanzadas en dominios concretos, algo que ya conocíamos desde hace décadas con otros sistemas expertos. Superar el test de Turing, ser creativo o rendir mejor que humanos en tareas específicas no equivale a poseer una inteligencia comparable a la humana en sentido amplio.

¿Por qué es relevante?

Para mí, los LLMs no son AGI, sino una forma de inteligencia diferente a la nuestra y muy buena en algunas cosas. Tienen capacidades sorprendentes junto a limitaciones estructurales profundas: carecen de agencia, identidad, comprensión social, conciencia (¡!), abstracción, etc. Por si fuera poco, su forma de razonar, incluyendo las alucinaciones, no se parecen a “lo nuestro”. Es algo diferente. Por ello, llegar a la conclusión de AGI así, me ha dejado un poco “helado” ciertamente.

#4 Copilot, su nombre y estrategia de los “incumbentes”

Un artículo sobre Microsoft Copilot en Wall Street Journal muy provocador. El texto señala uno de los grandes errores clásicos de los incumbentes frente a una tecnología disruptiva: intentar ponerla en todas partes a la vez bajo una misma etiqueta.

Detalles

En el caso de Microsoft, la decisión de llamar Copilot a casi cualquier funcionalidad con IA ha generado más confusión que valor. Los usuarios esperan coherencia, integración y continuidad entre herramientas que comparten nombre, pero la realidad es que muchas de esas funciones no están pensadas para funcionar juntas ni ofrecen una experiencia consistente. El resultado no es adopción entusiasta, sino frustración.

¿Por qué es relevante?

El texto, de forma muy directa, dice que Copilot se ha convertido en lo que en su día fue Watson: un paraguas de marketing más que un producto claramente definido. No es un problema exclusivo de Microsoft, sino un patrón recurrente en grandes compañías cuando aparece “la nueva cosa”. Pero aún así, ¿será realmente el fracaso que describe? Tengo mis dudas, pero bueno, no soy el Wall Street Journal, sino un pringao de Bilbao.

#5 Taiwan protegiendo el marco laboral en la era de la IA: ¿una apuesta de futuro?

Taiwán acaba de dar un paso decisivo en la regulación de la inteligencia artificial con la aprobación de su ley básica de IA. Recordaréis cuando el COVID-19 que siempre hablábamos de Taiwan como un pionero en muchas cuestiones. Aquí también lo ha sido.

Detalles

Uno de los aspectos más innovadores de la ley es la protección explícita de los derechos laborales, contemplando medidas para las personas que pierdan su empleo como consecuencia de la automatización y el uso de IA.

Un enfoque humano y anticipatorio que reconoce que el progreso tecnológico debe ir acompañado de responsabilidad social.

¿Por qué es relevante?

La norma busca impulsar la innovación sin perder de vista la ética, la transparencia y el impacto social de la IA, convirtiéndose en una referencia internacional en un momento clave de transformación digital. Otros países harían bien en observar este “experimento natural”.

🔊 Un audio

“De la armada a la presidencia de SENER”. Más aquí, con Andrés Sendagorta. Fascinante historia.

💬 Un comentario en redes sociales

Un estudio, éste, muy interesante. De Harvard Business Review. Sostener una postura corporativa basada en que las personas “simplemente usen la IA para hacer cosas” nunca ha sido suficiente. Es falta de estrategia y gobernanza. La adopción de la inteligencia artificial en las empresas no es un reto tecnológico, sino un reto de liderazgo y dirección. ¿En qué deberían invertir su tiempo las personas? ¿Cómo se organiza realmente el trabajo? ¿Cómo volvemos a situar a las personas en el centro en un contexto profundamente transformado por la tecnología?

🎲 Una lectura aleatoria

Sigo con mis marcianadas de lecturas random. En las últimas semanas estoy obsesionado con un concepto que hace unos días me proponía profundizar un directivo de nuestro país: el “truth coping”. Durante años, las organizaciones han aprendido a gestionar el cambio. Ahora necesitan aprender algo más incómodo: afrontar la verdad. El truth coping no va de optimismo ni de resistencia al cambio. Va de la capacidad (individual y colectiva) de mirar de frente la realidad, aunque sea compleja, ambigua o incómoda. Especialmente en un contexto marcado por la inteligencia artificial, la automatización y la redefinición constante del trabajo. Afrontar la verdad implica reconocer que no todo el trabajo aporta valor, que no todas las tareas merecen seguir existiendo y que no todas las decisiones pueden seguir tomándose como antes. Implica aceptar que la tecnología no solo acelera procesos, sino que cuestiona identidades profesionales, estructuras de poder y formas tradicionales de liderazgo. Significa crear espacios donde se puedan decir las cosas difíciles, tomar decisiones alineadas con la realidad (no con la nostalgia) y poner a las personas en el centro, no como eslogan, sino como criterio estratégico. En un mundo que cambia más rápido que nuestra capacidad de asimilarlo, el truth coping se convierte en una competencia clave del liderazgo contemporáneo: la habilidad de mirar la realidad tal como es… y actuar en consecuencia. Por cierto, es una habilidad que mezcla asuntos de antropología, psicología, sociología, etc. Fascinante.

Muchas gracias por leerme una semana más ❤️

¿Te gusta esta newsletter? ¡Suscríbete! ¡Compartid el enlace con vuestros amigos! ¡Enlazad el boletín en redes sociales!