Hola, soy Alex Rayón Jerez. De #bilbao y #millennial (por los pelos).

Bienvenido/a a mi newsletter Digital & Data. Damos una especial bienvenida a los 5 nuevos suscriptores/as con los que somos ya 10.158 reflexionando sobre cómo los humanos no entendemos una tecnología hasta que no la adoptamos masivamente. Que es, precisamente, lo que está ocurriendo con las tecnologías digitales.

Semana divertida y productiva, si no fuera por la situación contextual del mundo

Suscríbete aquí 👇

📷 Una imagen

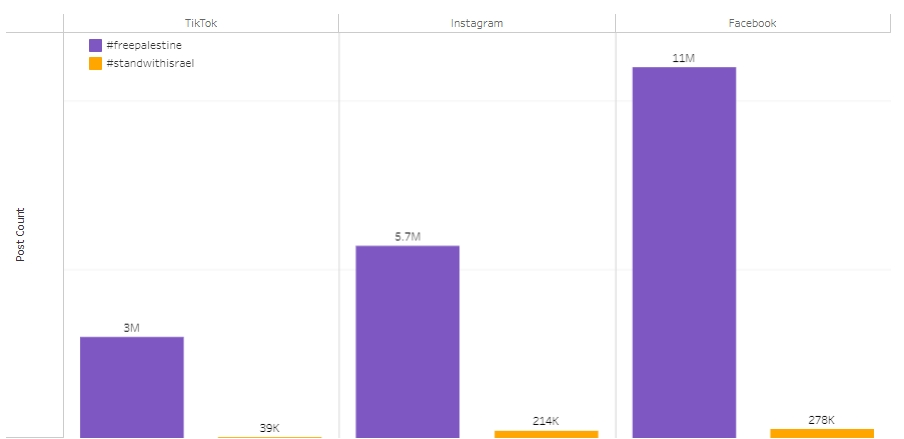

¿Tienes la sensación de estar leyendo más mensajes en apoyo a Palestina que a Israel? Es así. TikTok ha publicado unos datos bien interesantes de la cantidad de contenido etiquetado con #freepalestine o #standwithisrael. En realidad el informe habla del papel activo que está siguiendo TikTok para la moderación de contenidos en torno al discurso de odio, la desinformación, etc. Es interesante leerlo. Pero de todo, de largo, lo que más me ha llamado la atención es lo que llamo yo la “futbolización de los conflictos”. Hay que opinar y posicionarse: o con unos o con otros. Los comentarios que hay en redes sociales, nunca son neutros o apelan a la prudencia. Desde que leí “Los árabes”, de Eugene Rogan, me quedó claro que estamos hablando de un conflicto MUY complejo. Mi postura es clara: respeto y prudencia. Mucha historia por detrás. Difícil posicionarse. En una guerra todos perdemos. Pero en las redes sociales, la futbolización es muy acusada. No vende ser neutro. Seguramente aquí tampoco. Pero es mi humilde newsletter, así que sí, soy neutro, digo que es complejo.

📚 Cinco lecturas

#1 Sam Altman, cesado como CEO de OpenAI

He retrasado a hoy la publicación de esta newsletter porque esta madrugada me he enterado que el Consejo de Administración de OpenAI ha echado a Sam Altman, co-fundador y uno de los principales cerebros detrás de la revolución de la IA Generativa actual. También el presidente se ha ido. Y la sangría de investigadores clave que deciden irse, sigue. Un terremoto en el sector, que recuerda a cuando Steve Jobs fue echado por el Consejo de Apple en 1985 (el resto es historia). ¿Cómo ha podido ocurrir? Veamos.

Detalles

Es muy difícil saber lo que ha ocurrido. He podido hablar con dos amigos que viven allí cerca y trabajan en el sector. Parece que el principal motivo apunta al delicado equilibrio entre la seguridad en el desarrollo de la IA y el momentum del sector. ¿Ir más rápido obviando la ética o frenar el desarrollo hasta entender realmente de lo que estamos hablando? Sam Altman parece que invitaba a la prudencia. Lo lleva defendiendo desde el 2020 (esto no es nuevo). A la Cuenta de Resultados, parece no le encajaba esa visión.

La versión oficial es que el Consejo ha perdido la confianza. Que la comunicación no fluía. No parece ser algo sólido, parece el típico comunicado que “no dice nada” (vamos, primero de comunicación corporativa). En Internet llevo 18 horas leyendo todo tipo de teorías: una fuga de seguridad no comunicada, eventuales casos de abusos a su hermana por parte de Sam que se estarían investigando, divergencias de cómo ganar aún más dinero, la regulación cuando llegue ChatGPT5 (que parece cambiará muchas cosas de nuestras vidas), etc.

OpenAI no es una empresa. Tiene una estructura sofisticada donde su joven Consejo, supervisa una empresa sin ánimo de lucro donde tiene como accionista a Microsoft, que ha limitado sus beneficios con un tope y que debe dar a Microsoft el 75% de lo que gane. Una complejidad, que no será fácil de gobernar. La teoría lo soporta todo. La práctica, es otro mundo.

¿Por qué es relevante?

La noticia nos entristece especialmente a los que tenemos respeto al necesario prudente desarrollo de la IA. Sam era un CEO transparente y querido públicamente que cambió la IA y nuestras vidas para siempre. Las comparaciones con el golpe que derrocó a Steve Jobs son muchas y variadas.

#2 ¿Te sientes multitarea? Ten cuidado

No es nueva la evidencia, pero conviene recordarla. Estamos estos días entrevistando a varias personas para un puesto que tenemos abierto en Brain & Code. Las entrevistas me gusta hacerlas para conocer más sobre las personas. Varios destacan que son multitasking. No es necesariamente una virtud (pero no se lo digo en directo :)).

Detalles

Este paper, uno de mis favoritos, apunta a varios problemas sobre la multitarea: cambiar entre diferentes contextos de trabajo o procesos de información sobrecarga nuestra memoria de trabajo. Eso nos estresa y no nos ayuda a memorizar o razonar. Luego os enfadáis cuando no respondo llamadas o WhatsApp entre semana :)

¿Por qué es relevante?

La memoria de trabajo nos permite razonar y pensar ágilmente. Si la cargamos, no lo haremos. Además, nos permite establecer conexiones significativas, lo que limita nuestra creatividad a su vez. Pensadlo bien y organizad bien vuestro trabajo.

#3 Nepal ha bloqueado TikTok: ¿por qué?

El Gobierno de mi querido Nepal (país en el que disfruté como en pocos de lo que es la naturaleza y la vida), ha prohibido TikTok por “perturbar la armonía social”. ¿Por qué? Entendámoslo.

Detalles

Antes de opinar, entendamos los contextos en los que se toman decisiones. Dice el gobierno que “afecta las estructuras familiares y las relaciones sociales”. India hizo lo mismo. Tenemos que entender que son culturas por un profundo respeto a la armonía y cohesión social.

El ministro Rekha Sharma, dice que ha ayudado a difundir contenido no apropiado. Además, señala que ha ayudado a que se difundan hasta 1.600 casos de ciber crimen.

¿Por qué es relevante?

Indonesia y Pakistán tienen “vetos parciales”. En definitiva, parece que esa “evasión de su responsabilidad” que suelen tener estas plataformas, hay determinados contextos, en los que no sirve.

#4 La Inteligencia Artificial y el Agua

Ya os he hablado de la estrecha relación que tiene la IA con el consumo de agua. Resumiéndolo mucho, estamos más en la era del “Big Data” (procesamiento de grandes volúmenes de datos) que de la Inteligencia Artificial. Pero la etiqueta es la IA. Para computar datos, hay que refrigerar ante la exigencia del calor generador. Y ahí el agua, entra.

Detalles

En 2022, Google ha incrementado un 20% su consumo de agua. Microsoft, propietaria de un 75% de OpenAI, en el mismo 2022, un 34% más de consumo. Amazon, en su informe de sostenibilidad, no da datos exactos (pueden imaginar lo que pienso), pero se compromete a ser “agua positiva”.

Hablo de Google, Microsoft y Amazon porque son las propietarias del 50% de los macrocentros de datos del mundo. Un macrocentro/hipercentro es aquel que cuenta con más de 5.000 servidores. Todavía recuerdo montar un servidor en mi época joven… una odisea.

¿Por qué es relevante?

Los centros para producir resultados de IA Generativa consumen mucho más que los ordinarios. Como siempre: mientras la economía no internalice en su estructura de costes y precios el medioambiente, hablaremos cuatro freaks en nuestras newsletters y poco más.

#5 Hacer redes neuronales con redes neuronales naturales

El punto anterior nos tiene que recordar que tenemos un problema de sostenibilidad claro. Nadie habla de ello. No da dinero. El mundo no habla de estas cosas. Interesa más aquello que automatiza y da dinero. Pues bien, una empresa Suiza se ha propuesta atajar el problema creando redes neuronales artificiales con redes neuronales naturales.

Detalles

La empresa se llama FinalSpark y se dio cuenta de una cosa sencilla: las redes biológicas naturales consumen menos energía que las artificiales. ¿Por qué no ponerlas a trabajar sobre modelos complejos?

Hay mucho paper que expone cómo las neuronas pueden ser entrenadas y computadas para resolver cualquier problema. ¿Y si un ordenador las coordina? Es menos demandante de energía.

¿Por qué es relevante?

Porque son abundantes en el mundo las neuronas naturales: se pueden obtener de nuestra piel. Ahora piensa en el punto 4 y 5 de este boletín.

🔊 Un audio

El inventor del futbolín, Alejandro Finisterre, es uno de mis grandes ídolos. Básicamente, porque me dio muchas alegrías siendo joven pasando grandes ratos con mis amigos jugando a ese gran juego. Esta inédita entrevista es historia viva.

💬 Un comentario en redes sociales

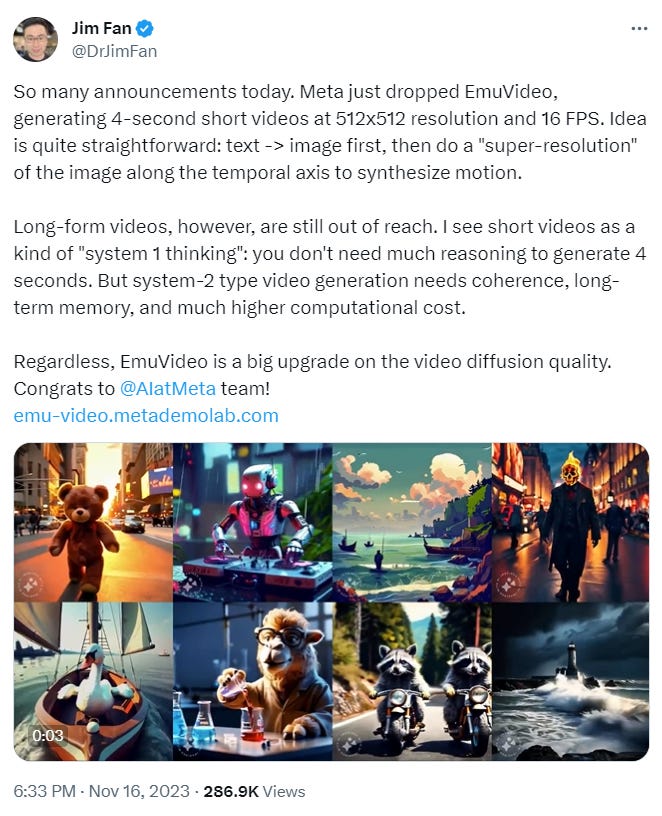

Meta acaba de anunciar https://emu-video.metademolab.com/. Pruébenla, pueden generar vídeos a partir de prompting. Y miren el hilo que pongo a continuación para que se les ocurran ideas de vídeos ;-)

https://twitter.com/DrJimFan/status/1725205535585419761

🎲 Una lectura aleatoria

El artículo "AI Chatbots Can Guess Your Personal Information", es MUY importante que lo leáis. Los chatbots avanzados, como ChatGPT, pueden inferir información personal sensible de nosotros/as, los usuarios, incluso de conversaciones que parecen inocuas. En una investigación liderada por Martin Vechev, profesor de ciencias de la computación de la ETH Zurich, entrenaron a un modelo de lenguaje en un conjunto de datos de 100.000 millones de palabras de texto y código. Luego, utilizaron el modelo para predecir la información personal de los usuarios, como su raza, ubicación, ocupación y preferencias. El modelo pudo predecir la raza de los usuarios con un 87% de precisión, su ubicación con un 77% de precisión y su ocupación con un 70% de precisión. También pudo predecir las preferencias de los usuarios, como sus intereses musicales o sus pasatiempos, con un 65% de precisión. Luego a veces no entendemos por qué las compañías toman medidas para proteger el uso de estas máquinas. Háganse una auditoría personal, por favor. Y, por cierto, nada que no se haga ya sin IA Generativa ;-)

📰 En medios

“Actualidad diocesana de la semana: Inteligencia Artificial” [Diócesis de Bilbao]

“Cuando Inteligencia Artificial y sostenibilidad van de la mano“ [Naiz]

¿Te gusta esta newsletter? ¡Suscríbete! ¡Compartid el enlace con vuestros amigos! ¡Enlazad el boletín en redes sociales!